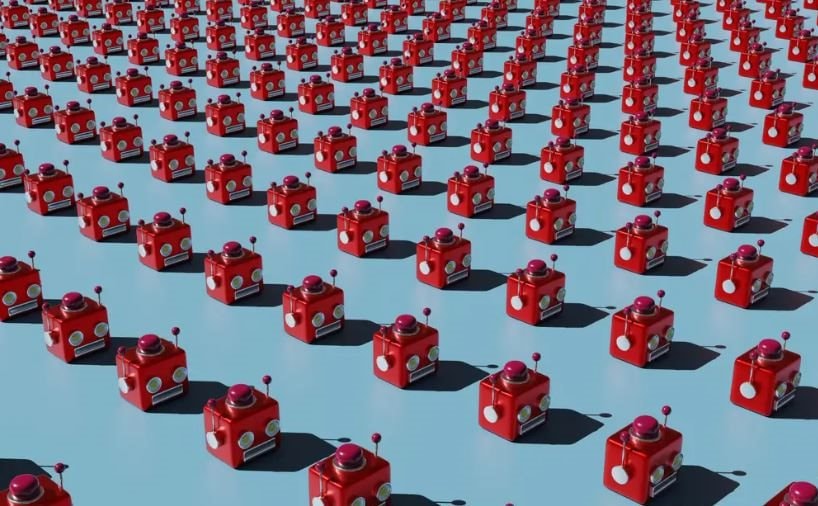

Nhà khoa học phát hiện hơn 1.000 bot spam AI cố lừa đảo, trộm hồ sơ MXH của người dùng

Nhịp đập khoa học - Ngày đăng : 20:22, 24/08/2023

Nghiên cứu được thực hiện bởi Kai-Cheng Yang (nhà nghiên cứu khoa học xã hội tính toán) và Filippo Menczer (giáo sư khoa học máy tính) đã phát hiện ra rằng khả năng tạo văn bản đáng tin cậy của ChatGPT đang được sử dụng để chạy botnet trên mạng xã hội X (trước đây gọi là Twitter).

Botnet là gì?

Botnet là mạng lưới gồm hàng trăm bot độc hại và các chiến dịch spam trên mạng xã hội (MXH) mà các bộ lọc spam hiện tại có thể không phát hiện được. Chúng được triển khai vì nhiều lý do. Trong trường hợp được nêu trong bài này, các botnet đang quảng bá tiền mã hóa và NFT (tài sản số) lừa đảo.

Các tài khoản bot cố gắng thuyết phục mọi người đầu tư vào tiền mã hóa giả và thậm chí có thể lấy cắp từ ví tiền mã hóa hiện có của họ.

Botnet mà Kai-Cheng Yang và Filippo Menczer phát hiện trên X chứa hơn 1.000 bot đang hoạt động. Các bot theo dõi và phản hồi các bài đăng của nhau với nội dung do ChatGPT tạo ra, thường đăng những bức ảnh selfie lấy từ hồ sơ con người để xây dựng các tài khoản giả mạo.

Filippo Menczer cho biết sự phát triển của MXH đã mang lại cho những kẻ xấu tiếp cận lượng lớn người dùng và kiếm tiền từ nội dung sai lệch hoặc gây hiểu lầm. “Các công cụ AI mới giúp kẻ xấu giảm chi phí để tạo ra nội dung sai lệch nhưng tạo được sự đáng tin cậy ở quy mô lớn, đánh bại các hệ thống kiểm duyệt yếu ớt của các nền tảng MXH", ông nói.

Vài năm qua, các bot trên mạng xã hội (các tài khoản do phần mềm kiểm soát toàn bộ hoặc một phần) đã được triển khai thường xuyên để khuếch đại thông tin sai lệch về các sự kiện, từ bầu cử đến các cuộc khủng hoảng sức khỏe cộng đồng như COVID-19. Những bot trên MXH này rất dễ bị phát hiện vì hành vi giống robot và giả mạo thiếu thuyết phục.

Thế nhưng, các công cụ generative AI như ChatGPT tạo ra văn bản giống con người chỉ trong vài giây. Kai-Cheng Yang nói với trang Insider: “Sự tiến bộ của các công cụ AI sẽ làm biến dạng vĩnh viễn ý tưởng về thông tin trực tuyến”.

Generative AI là một loại trí tuệ nhân tạo được lập trình để tự động tạo ra nội dung mới, như văn bản, hình ảnh, âm thanh và video. Nó khác với các hệ thống AI khác như máy học sâu (deep learning) hoặc học máy (machine learning) trong việc dự đoán kết quả từ dữ liệu đã có sẵn. Thay vì dựa trên dữ liệu huấn luyện, hệ thống generative AI có khả năng tự tạo ra dữ liệu mới và phong phú hơn.

Cuộc khảo sát cho biết các bot AI trong mạng mà nhà nghiên cứu phát hiện chủ yếu đăng về các chiến dịch tiền mã hóa và NFT lừa đảo, đồng thời quảng bá các trang web đáng ngờ về các chủ đề tương tự. Chúng có thể được viết bằng ChatGPT.

AI có thể tạo ra toàn bộ nội dung sai lệch cho website

Các công cụ giống ChatGPT đã tạo ra trang web tin tức chung chung mang tính spam. Nhiều trang trong số đó đăng tải những thông tin sai sự thật trắng trợn.

NewsGuard, công ty tư nhân đánh giá độ tin cậy của các trang web tin tức và thông tin, đến nay đã tìm thấy hơn 400 trang web do AI tạo ra như một phần của cuộc kiểm tra đang diễn ra kể từ tháng 4.

Hiện tại, cả NewsGuard, Kai-Cheng Yang và Filippo Menczer đều có thể phát hiện riêng nội dung spam do AI tạo ra thông qua dấu hiệu rõ ràng mà chatbot hiện tại có.

Khi ChatGPT không thể đưa ra câu trả lời vì lời nhắc đi ngược lại chính sách của OpenAI hoặc liên quan đến thông tin cá nhân, chatbot AI này sẽ đưa ra phản hồi được chuẩn bị trước: "Tôi xin lỗi, nhưng tôi không thể tuân thủ yêu cầu này".

Các nhà nghiên cứu tìm kiếm vị trí những phản hồi kiểu này xuất hiện trong nội dung của bot, dù trên trang web hay trong tweet. Họ sử dụng các cụm từ để phát hiện những phần của chiến dịch bot rộng hơn và từ đó khám phá phần còn lại trong mạng lưới spam. Tuy nhiên, các chuyên gia lo ngại rằng khi chatbot bắt chước con người tốt hơn, những dấu hiệu nhận biết như vậy sẽ biến mất và khiến việc theo dõi nội dung do AI tạo ra trở nên khó khăn hơn nhiều.

Wei Xu, giáo sư khoa học máy tính tại Viện Công nghệ Georgia (Mỹ), nói với trang Insider rằng việc phát hiện và lọc nội dung do AI tạo ra sẽ trở nên khó khăn hơn khi ngày càng có nhiều kẻ xấu khai thác nó.

Mối lo ngại của Wei Xu có thể sớm trở thành hiện thực. Europol, cơ quan thực thi pháp luật của Liên minh châu Âu (EU), dự đoán 90% nội dung internet sẽ do AI tạo ra vào năm 2026.

Theo Wei Xu, miễn là có nhiều động cơ và chi phí thấp hơn để tạo ra nội dung bằng AI thì những kẻ xấu sẽ luôn vượt xa những người cố gắng ngăn chặn nó nếu không có quy định cụ thể.

"Nó tương tự như nước đóng chai bằng nhựa. Chúng ta biết đây là một thảm họa với môi trường, nhưng miễn là rẻ mà không bị phạt nặng thì nó sẽ tồn tại rộng rãi", Wei Xu nói.

Các cơ quan quản lý đang chạy đua để bắt kịp làn sóng spam

Một nghiên cứu gần đây của các học giả châu Âu cho thấy các trình phát hiện nội dung AI hiện có, chẳng hạn như ZeroGPT và OpenAI AI Text Classifier, không đáng tin cậy và thường không thể phân biệt chính xác sự khác biệt giữa nội dung do con người hay AI tạo ra. Dịch vụ của OpenAI có tỷ lệ chính xác thấp đến mức công ty đã quyết định đóng cửa nó.

Vào tháng 7, chính quyền Biden thông báo rằng hãng lớn trong lĩnh vực AI, bao gồm cả Google, Microsoft và OpenAI, đã cam kết với Nhà Trắng về việc xây dựng các biện pháp ngăn chặn để giảm nguy cơ từ AI.

Một biện pháp như vậy là gắn nhãn ẩn cho nội dung do AI tạo ra để giúp mọi người phân biệt nó với nội dung do con người tạo, theo Nhà Trắng.

Song, Filippo Menczer, đồng tác giả nghiên cứu của Đại học Indiana, cho biết những biện pháp bảo vệ này có thể sẽ không ngăn được những kẻ xấu vượt qua chúng.

Kai-Cheng Yang nói rằng việc theo dõi mô hình hoạt động trên MXH của nghi phạm, dù họ có lịch sử lan truyền các tuyên bố sai lệch hay không cũng như mức độ đa dạng về ngôn ngữ và nội dung các bài đăng trước đó của họ, là cách đáng tin cậy hơn để xác định bot. Ông khuyên mọi người phải cảnh giác hơn về bất cứ điều gì gặp trên mạng, đồng thời nói thêm rằng AI tạo ra nội dung sẽ "có tác động sâu sắc đến hệ sinh thái thông tin".